在数字化浪潮中,运营商作为信息基础设施的核心建设者与运营者,其数据资产规模庞大、类型复杂、价值密度高。海量数据的涌入也给数据集群的治理带来了前所未有的挑战。数据处理作为数据治理的核心环节,直接关系到数据质量、分析效率与业务价值释放。本文将聚焦运营商大规模数据集群,探讨数据处理的关键实践与指南。

一、 数据处理面临的挑战

运营商数据通常具有“4V”特征:体量巨大(Volume)、来源与类型多样(Variety)、产生与处理速度快(Velocity),以及价值密度不均但潜在价值高(Value)。具体到数据处理层面,主要面临以下挑战:

- 数据孤岛与整合难:业务支撑系统(BSS)、运营支撑系统(OSS)、管理支撑系统(MSS)等产生的数据格式不一、标准各异,整合难度大。

- 数据质量参差不齐:原始数据中存在大量噪声、缺失、不一致和重复记录,直接影响分析结果的准确性。

- 实时处理需求迫切:对于网络监控、实时营销、欺诈检测等场景,需要低延迟的流式数据处理能力。

- 成本与效率的平衡:存储与计算资源成本高昂,需要在处理效率、结果准确性和经济性之间找到最佳平衡点。

- 隐私与安全合规:用户通信、位置等敏感信息处理需严格遵循《网络安全法》、《数据安全法》、《个人信息保护法》等法规要求。

二、 数据处理核心实践框架

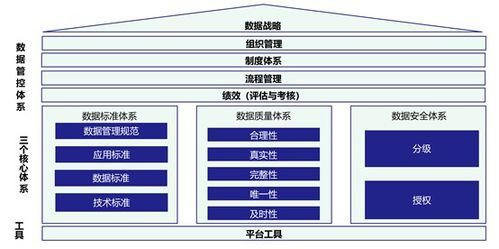

为应对上述挑战,一个系统化的数据处理实践框架至关重要。该框架可概括为“三层四环”。

三层架构:

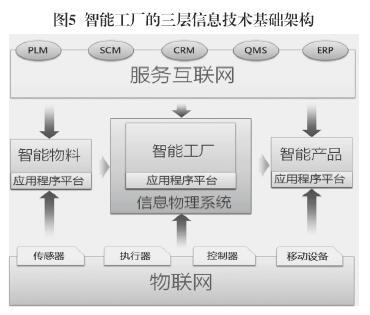

1. 统一接入层:建立标准化的数据接入通道,对来自网络设备、业务平台、外部合作方的多源异构数据进行统一采集、缓冲与初步分类。广泛采用Kafka、Flume等工具,实现批流一体的接入能力。

2. 核心处理层:这是数据处理的心脏,可进一步细分为:

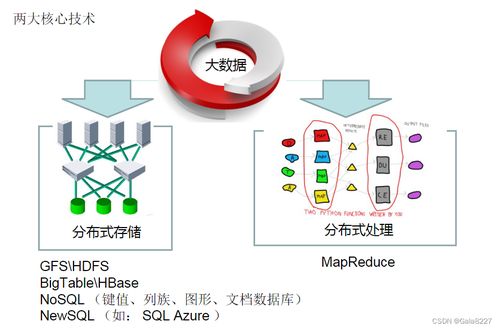

- 离线批量处理:针对历史数据、海量明细数据的深度清洗、转换与整合(ETL/ELT)。常用Hadoop、Spark等计算引擎,构建T+1或周期性的数据仓库与主题数据模型。

- 实时流式处理:针对时序数据、事件流的即时处理与分析。采用Flink、Spark Streaming、Storm等引擎,实现实时监控、即时决策支持。

- 交互式查询处理:为数据探索、即席查询提供低延迟响应。利用Presto、ClickHouse、Doris等MPP数据库或OLAP引擎。

- 统一服务层:将处理后的干净、标准、可信的数据,通过API、数据服务总线、数据门户等方式,安全、高效地供给给下游的分析应用、业务系统与数据消费者。

四环流程(贯穿三层架构的质量闭环):

1. 发现与评估:通过数据资产目录、元数据管理,自动扫描和评估入湖数据的结构、质量、血缘和敏感性。

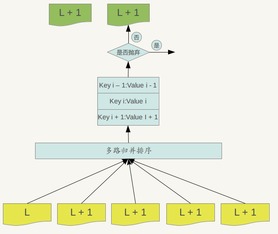

2. 清洗与标准化:定义并执行数据质量规则(如完整性、一致性、有效性校验),进行脏数据清洗、格式标准化、代码统一(如将各系统不同的“性别”编码统一)。运营商尤其需注重用户标识(如手机号)的跨系统打通与隐私脱敏。

3. 整合与建模:基于业务主题(如“客户”、“产品”、“网络”、“服务”),将不同来源的数据进行关联、整合,构建企业级的一致性维度模型和汇总事实表,形成可复用的数据资产。

4. 监控与优化:建立全链路的数据处理作业监控体系,跟踪任务执行效率、资源消耗、数据质量波动。基于监控反馈持续优化处理逻辑、资源配置与调度策略。

三、 关键技术与最佳实践

- 批流融合与Lambda/Kappa架构演进:逐步向以Flink为核心的流批一体架构演进,简化技术栈,实现同一套逻辑处理实时与历史数据,降低维护成本。

- 数据湖与数据仓库的协同:利用数据湖(如基于HDFS或对象存储)存储原始和海量明细数据,提供灵活的探索能力;通过数据仓库(或湖仓一体平台)承载经过深度治理、高性能查询的结构化数据模型,形成“湖仓协同”的互补优势。

- 自动化数据质量管理:将质量规则嵌入处理流水线,实现从发现问题、告警、到部分场景下自动修复的闭环。建立数据质量分体系,量化评估并持续提升数据可信度。

- 隐私计算技术的应用:在涉及用户隐私的数据融合与分析场景(如跨域营销),采用联邦学习、安全多方计算、可信执行环境等技术,实现“数据可用不可见”,满足合规要求。

- 云原生与资源弹性:在容器化(Kubernetes)和微服务架构下部署数据处理组件,实现计算存储分离、资源弹性伸缩,有效应对业务峰值,提升资源利用率。

- 全链路血缘与影响分析:构建从数据接入到最终消费的端到端血缘图谱。当源数据或处理规则变更时,能快速评估影响范围,确保下游应用稳定性。

四、 组织与流程保障

技术之外,组织与流程是成功落地的保障:

- 确立数据所有权:明确各业务域的数据责任方(Data Owner),由其负责定义数据标准和质量规则。

- 组建专业的数据工程团队:负责数据处理平台的建设、运维与核心ETL/流处理任务的开发。

- 建立敏捷的数据开发流程:将数据处理任务像代码一样进行版本管理、CI/CD(持续集成/持续部署),提升交付效率与可靠性。

- 培养数据文化:通过培训与工具赋能,让业务人员能够自助使用高质量的数据,形成“治理-消费-反馈”的良性循环。

###

运营商大规模数据集群的数据处理治理,是一项涉及技术、流程与组织的系统性工程。没有一劳永逸的解决方案,其核心在于构建一个灵活、健壮、可持续演进的数据处理体系。通过采纳批流一体、湖仓协同、自动化质量管理等先进实践,并配以坚实的组织保障,运营商能够将数据“包袱”转化为真正的战略资产,为5G时代的精准运营、智慧决策与业务创新奠定坚实的数据基石。