随着大数据和复杂关系分析的兴起,图数据库因其在表达和查询关联数据方面的天然优势而受到广泛关注。当图数据的规模增长到单机无法承载时,分布式架构与数据切分技术便成为核心解决方案。本文将深入探讨图数据库中的分布式设计、数据切分(或称“切图”)策略以及在此架构下的数据处理挑战与模式。

一、 分布式图数据库的必要性与目标

传统的关系型数据库在处理高度关联的、多跳查询时性能往往受限。图数据库通过节点、边和属性来直接映射现实世界的关系,但在社交网络、知识图谱、金融风控等场景下,图的规模可能达到数十亿甚至万亿个顶点和边。分布式架构的核心目标在于:

- 可扩展性:通过增加机器节点来水平扩展存储与计算能力。

- 高可用性:避免单点故障,保障服务持续性。

- 高性能:并行处理查询与计算任务,降低响应延迟。

图的强关联特性使得其分布式化比键值对或文档数据更为复杂。关键挑战在于,一个高效的查询(如查找朋友的朋友)可能需要访问分布在多个服务器上的数据,网络通信开销可能成为瓶颈。

二、 数据切分(切图)的核心策略

数据切分是将庞大的图数据划分并分配到不同物理节点的过程。其策略直接决定了分布式图数据库的性能上限。主要方法有:

- 边切分:将边分配到不同分区,而顶点信息可能被复制。这是最常用的策略。例如,一条连接顶点A(在服务器1)和顶点B(在服务器2)的边,可以存储在服务器1、服务器2或第三个服务器上。其优点是保持边的局部性,但可能导致顶点数据冗余,并使得围绕某个顶点的遍历(收集其所有边)需要跨多台机器查询。

- 点切分:将顶点及其出边(有时包括入边)分配到同一分区。这保证了针对单个顶点的局部操作非常高效。但是,一个顶点的入边可能来自其他分区的顶点,因此处理入边查询或反向遍历时仍需跨分区通信。

- 混合切分与流式图划分算法:为了最小化跨分区通信,高级系统会采用混合策略或基于启发式算法(如Metis)进行预处理划分,目标是最小化边切割数。还有在数据加载时动态进行的流式划分(如基于哈希或范围)。

切分的核心权衡始终是 “计算局部性” 与 “负载均衡” 以及 “存储冗余” 之间的平衡。一个好的切分方案应使大多数查询能在尽可能少的分区内完成。

三、 分布式环境下的图数据处理

在数据被切分并分布后,系统的数据处理模式需要相应适配。

- 查询处理:

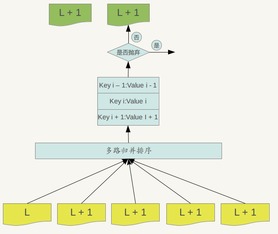

- 遍历查询:如广度优先搜索(BFS)、最短路径查询。这类查询需要系统在分区间高效地传递“消息”或“状态”。通常采用类似BSP(整体同步并行)或GAS(聚集-应用-散射)的模型,通过多轮迭代完成,每轮涉及局部计算和跨机器通信。

- 邻域查询:获取一个顶点的所有邻居。如果采用点切分,这可能是局部操作;若采用边切分,则可能需要从多个分区收集数据。

- 图计算:

- 对于PageRank、社区发现、图嵌入等全局迭代算法,分布式框架(如Pregel、GraphX)将计算抽象为以顶点为中心的超步序列。每个顶点在每个超步中根据接收到的消息更新状态,并发送新消息给邻居。系统的优化重点在于减少通信量和实现高效的容错。

- 数据写入与一致性:

- 图的更新(添加顶点/边)必须根据切分策略路由到正确的分区。在分布式环境中,需要一致性协议(如Raft、Paxos)来保证跨分区事务(例如,确保一条边及其两端的顶点正确关联)的ACID或最终一致性。这通常是分布式图数据库设计的难点之一。

- 负载均衡与动态调整:

- 真实世界的图往往具有幂律分布特性,少数顶点(超级节点)拥有海量连接。这极易导致数据倾斜,使某个分区负载过重。先进的系统支持动态再平衡,将过热的分区进行二次分割或迁移。

四、 业界实践与

目前主流的分布式图数据库(如Neo4j Fabric、JanusGraph、TigerGraph、阿里云的GraphScope等)在切分策略和计算模型上各有侧重。例如,JanusGraph依赖于底层分布式存储(如Cassandra、HBase)进行边切分存储;TigerGraph采用点切分并强调本地计算以最小化通信。

分布式图数据库的设计是数据切分策略、计算模型和一致性协议的深度融合。“切图”是基石,决定了数据的物理布局;分布式处理引擎是大脑,负责高效执行算法与查询。未来的发展趋势将集中于更智能的自适应切分、更低的跨分区查询延迟、以及对实时图更新与计算的更好支持,以应对日益复杂的关联数据智能时代。