在当今数据爆炸的时代,如何高效、可靠地处理海量数据,成为了各行各业面临的共同挑战。Hadoop,作为大数据处理领域的奠基性框架,自诞生以来便为大规模数据处理提供了革命性的解决方案。它不仅仅是一个单一的工具,更是一个由多个核心组件构成的生态系统,其核心思想——分布式并行计算,已成为现代大数据处理的基石。

一、Hadoop的核心设计思想:分而治之

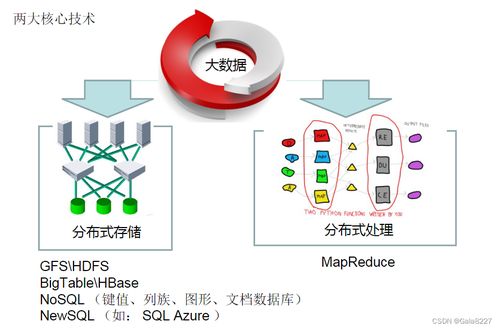

Hadoop的灵感来源于谷歌发表的MapReduce和Google File System(GFS)论文。其核心设计理念可以概括为“分而治之”:

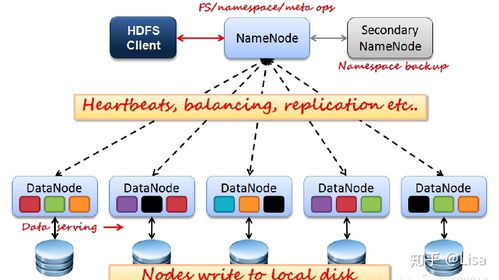

- 分布式存储(HDFS):它将一个超大的文件(如TB、PB级别)自动切分成多个数据块(默认128MB),并将这些数据块分散存储在一个由成百上千台普通商用服务器组成的集群中。这样,存储的负载和风险就被分散了,即使部分服务器出现故障,数据也不会丢失,因为每个数据块都有多个副本存储在不同的服务器上。

- 分布式计算(MapReduce):“计算向数据靠拢”。当需要对海量数据进行处理时(如统计、排序、分析),Hadoop会将计算任务(一个作业)分解成大量小的计算单元(Map任务和Reduce任务),然后将这些小的任务调度到存储着相关数据块的服务器上去执行。这极大地减少了数据在网络中的传输,提高了处理效率。

二、Hadoop的核心组件

一个典型的Hadoop生态系统主要包含以下核心组件:

- HDFS(Hadoop Distributed File System):分布式文件系统,负责数据的存储。它是Hadoop的“硬盘”,具有高容错性、高吞吐量的特点。

- MapReduce:分布式计算框架,负责数据的计算。它是一种编程模型,用户只需编写Map和Reduce两个函数,即可将复杂的并行计算任务交由框架自动完成。

- YARN(Yet Another Resource Negotiator):资源管理和作业调度系统。在Hadoop 2.0之后引入,它将资源管理和作业调度/监控的功能分离,使得Hadoop可以运行除MapReduce之外的其他计算框架(如Spark、Flink),大大提升了集群的利用率和灵活性。

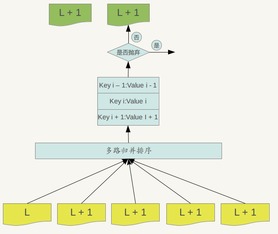

三、数据处理的基本流程(以MapReduce为例)

假设我们有一个巨大的文本文件,需要统计其中每个单词出现的次数,Hadoop的处理流程如下:

- 输入与分片:HDFS中的大文件被自动切分为多个数据分片。每个分片(如128MB)会启动一个Map任务。

- Map阶段:每个Map任务读取分配给它的数据分片,逐行处理。对于每一行文本,Map函数会将其拆分成单词,并为每个单词输出一个中间键值对,例如

<单词, 1>。这个过程在所有Map节点上并行执行。 - Shuffle与排序:这是框架自动完成的“魔法”步骤。系统会将所有Map任务输出的、具有相同键(即相同单词)的中间结果收集起来,通过网络传输到同一个Reduce任务节点,并按键进行排序。

- Reduce阶段:每个Reduce任务接收一组按键分组好的数据(如所有“Hadoop”单词的计数列表

[1,1,1,...])。Reduce函数对这组值进行合并计算(如求和),并输出最终结果,例如<Hadoop, 1500>。 - 输出:所有Reduce任务的输出最终被写入HDFS,形成最终结果文件。

四、Hadoop的优势与局限

优势:

高可靠性:数据多副本存储,计算任务自动重试,硬件故障对应用透明。

高扩展性:可通过线性增加廉价服务器来扩展存储和计算能力。

成本低廉:建立在普通商用服务器集群上,相比大型机和小型机,成本极低。

成熟的生态:拥有丰富的周边工具(如Hive用于SQL查询,HBase用于实时数据库,Sqoop用于数据导入导出等)。

局限:

MapReduce编程模型相对复杂:对于复杂的数据处理逻辑,编写MapReduce程序不够直观和高效。

实时性差:MapReduce作业的启动开销大,且基于磁盘的Shuffle过程较慢,不适合实时或迭代式计算(这正是后来Spark等框架着力解决的问题)。

* 资源管理在早期版本中不够灵活:YARN的引入已大大改善此问题。

###

尽管如今出现了许多性能更优、使用更便捷的新一代大数据处理框架(如Apache Spark),但Hadoop所奠定的分布式思想、HDFS提供的可靠存储方案以及YARN构建的资源管理层,依然是整个大数据技术栈不可或缺的底层支柱。理解Hadoop,是理解大数据处理技术演进脉络的关键第一步。对于希望进入大数据领域的学习者而言,掌握Hadoop的基本原理,就如同学习编程需要理解计算机基础一样重要。